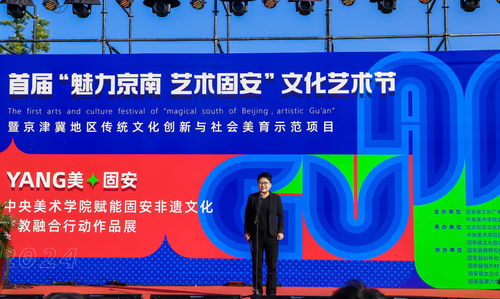

正芳華·共旅居——中老年文化藝術系列活動隆重開幕

金秋送爽,丹桂飄香。以“在一起,正芳華”為主題的中老年文化藝術系列活動在熱烈的掌聲與期待中隆重拉開帷幕。本次活動旨在為廣大的中老年朋友搭建一個展示才華、交流情感、豐富精神文化生活的廣闊平臺,通過一系列精心策劃的文化藝術交流,讓銀發歲月煥發青春光彩,讓旅居生活充滿詩情畫意。

開幕式現場,氣氛溫馨而熱烈。來自各地的中老年文藝愛好者齊聚一堂,他們精神矍鑠,容光煥發,充分展現了新時代中老年人積極樂觀、追求美好的精神風貌。主辦方在致辭中表示,中老年群體是社會寶貴的財富,他們擁有豐富的人生閱歷和深厚的文化積淀。本次活動以“旅居”為特色場景,將文化藝術融入休閑、康養與社交,正是為了回應廣大中老年朋友對高品質精神文化生活的迫切需求,讓藝術滋養心靈,讓友誼溫暖旅程。

本次系列活動內容豐富多彩,涵蓋了多個藝術門類。主要包括:

- 書畫藝術交流與展覽:邀請知名書畫家與愛好者共同揮毫潑墨,舉辦專題展覽,在筆墨丹青中暢敘幽情,傳承國粹。

- 聲樂與戲曲工作坊:組織經典紅歌傳唱、地方戲曲賞析與學唱活動,讓嘹亮的歌聲與婉轉的戲韻回蕩在旅居勝地。

- 攝影與短視頻創作沙龍:鼓勵參與者用鏡頭記錄旅居路上的美好瞬間,分享光影故事,學習新媒體技能,展現獨特視角。

- 手工工藝與非遺體驗:設置剪紙、編織、陶藝等手作課程,親身體驗傳統工藝的魅力,感受匠心傳承。

- 主題文藝匯演與聯誼晚會:為參與者提供綻放自我的舞臺,通過合唱、舞蹈、朗誦、器樂等表演形式,促進交流,增進友誼。

組織文化藝術交流活動是本次系列項目的核心。活動不僅注重內部的互動與展示,還積極搭建對外交流的橋梁。計劃邀請不同地區的藝術團體進行互訪演出,舉辦跨地域的文化座談與采風創作,讓思想在碰撞中升華,讓文化在交流中融合。這些活動將貫穿于風景如畫的旅居線路中,使山水之美與人文之韻相得益彰,真正實現“詩與遠方”的完美結合。

“莫道桑榆晚,為霞尚滿天。”此次“在一起,正芳華”系列活動的開幕,標志著一種更注重精神內涵與文化品質的中老年旅居生活方式正在興起。它不僅僅是一系列活動的集合,更是一個倡導積極老齡觀、助力文化養老的溫暖社群的開端。我們期待,通過持續的文化藝術浸潤與深度交流,每一位參與者都能在這里找到歸屬感、獲得成就感、提升幸福感,讓生命中的每一段年華都綻放出最絢麗的光彩。

系列活動現已正式啟航,歡迎廣大中老年朋友持續關注、踴躍參與,讓我們攜手同行,在藝術的道路上,共赴一場不老的青春之約,共譜一曲絢麗的夕陽華章。

最新產品